bs4爬虫实战二:获取双色球中奖信息

发布时间:2018-07-02 11:32:57编辑:Run阅读(6588)

目标分析:

访问双色球网站:http://www.zhcw.com/ssq/kaijiangshuju/index.shtml?type=0

右键查看源代码,发现这个框架的数据来源于:

http://kaijiang.zhcw.com/zhcw/html/ssq/list_1.html

点击下一页,可以看到url地址变成了

http://kaijiang.zhcw.com/zhcw/html/ssq/list_2.html

再次点击下一页,可以看到url地址变成了

http://kaijiang.zhcw.com/zhcw/html/ssq/list_3.html

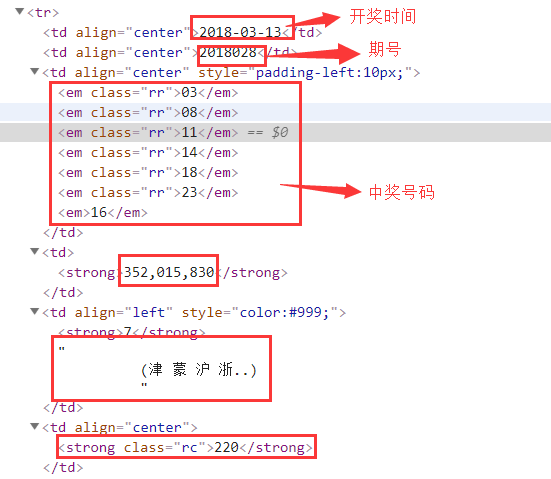

那么URL的变化已经很明显了,在看看具体内容的获取方式,右键查看代码:

爬虫遇到这种表格形式的数据,是最方便的,因为他们有固定的标签,可以很方便地获取数据,在写爬虫时,只需要先将<tr>标签挑选出来,然后再到其中过滤数据就可以了

项目实施:

新建一个get_caipiao.py文件,代码如下:

#!/usr/bin/env python

# coding: utf-8

from bs4 import BeautifulSoup

import urllib.request

from mylog import MyLog as mylog

import re

import time

class CaiPiaoItem(object):

lottery_date = None # 开奖日期

lssue = None # 期号

red1 = None # 第一个红色球号码

red2 = None # 第二个红色球号码

red3 = None # 第三个红色球号码

red4 = None # 第四个红色球号码

red5 = None # 第五个红色球号码

red6 = None # 第六个红色球号码

blue = None # 蓝色球号码

money = None # 销售额

firstprize = None # 一等奖人数

secondprize = None # 二等奖人数

class GetCaiPiao(object):

def __init__(self):

self.urls = []

self.filename = '双色球.txt'

self.log = mylog()

self.geturls()

self.items = self.spider(self.urls)

self.pipelines(self.items)

def geturls(self):

# 初始url地址

url = 'http://kaijiang.zhcw.com/zhcw/html/ssq/list_1.html'

htmlcontent = self.getresponsecontent(url)

soup = BeautifulSoup(htmlcontent, 'lxml')

# 获取最后一个p标签

tag = soup.find_all(re.compile('p'))[-1]

# 取出总页数---115

pages = tag.strong.get_text()

for i in range(1, int(pages)+1):

# 拼接每一页的url地址

url = r'http://kaijiang.zhcw.com/zhcw/html/ssq/list_' + str(i) + '.html'

self.urls.append(url) # 把每个url地址添加到urls列表

self.log.info(u'添加URL:{}到URLS\r\n'.format(url)) # 记录日志

with open(self.filename, 'w', encoding='utf-8') as f:

f.write("开奖日期 期号\t红1 红2 红3 红4 红5 红6 蓝7\t销售额\t1等奖人数\t二等奖人数\n")

def spider(self, urls):

items = []

for url in urls:

htmlcontent = self.getresponsecontent(url)

soup = BeautifulSoup(htmlcontent, 'lxml')

tags = soup.find_all('tr', attrs={})

for tag in tags:

if tag.find('em'):

item = CaiPiaoItem() # 实例化CaiPiaoItem类

tagtd = tag.find_all('td')

item.lottery_date = tagtd[0].get_text() # 获取开奖日期

item.lssue = tagtd[1].get_text() # 期号

itemEM = tagtd[2].find_all('em') # 获取所有的em标签

item.red1 = itemEM[0].get_text() # 获取第一个红球的号码

item.red2 = itemEM[1].get_text() # 获取第二个红球的号码

item.red3 = itemEM[2].get_text() # 获取第三个红球的号码

item.red4 = itemEM[3].get_text() # 获取第四个红球的号码

item.red5 = itemEM[4].get_text() # 获取第五个红球的号码

item.red6 = itemEM[5].get_text() # 获取第六个红球的号码

item.blue = itemEM[6].get_text() # 获取蓝球的号码

item.money = tagtd[3].find('strong').get_text() # 获取销售额

item.firstprize = tagtd[4].find('strong').get_text() # 获取一等奖中奖人数

item.secondprize = tagtd[5].find('strong').get_text() # 获取二等奖中奖人数

items.append(item) # 把item对象添加到items列表

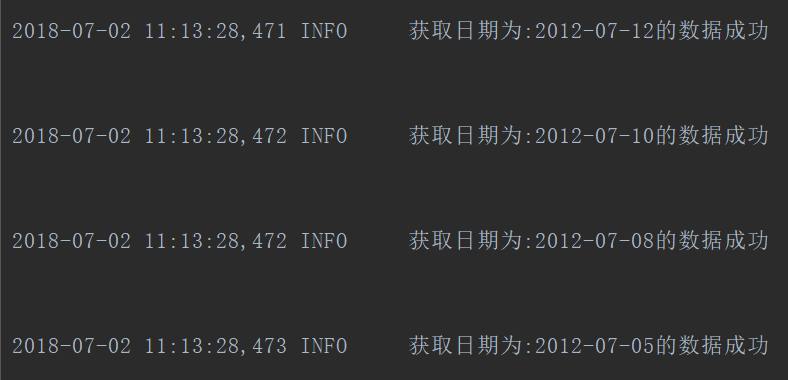

self.log.info(u'获取日期为:{}的数据成功'.format(item.lottery_date)) # 记录日志

return items # 返回items列表

def pipelines(self, items):

with open(self.filename, 'a', encoding='utf-8') as f:

for item in items:

f.write('{} {}\t{} {} {} {} {} {} {}\t{}\t{}\t{}\n'.\

format(item.lottery_date, item.lssue, item.red1, item.red2, item.red3, item.red4,\

item.red5, item.red6, item.blue,item.money,item.firstprize,item.secondprize))

self.log.info('将日期为:{}的数据存入{}'.format(item.lottery_date, self.filename))

def getresponsecontent(self, url):

try:

response = urllib.request.urlopen(url)

html = response.read().decode('utf-8')

except Exception as e:

self.log.error(u'Python 返回 url:{} 数据失败\n错误代码:{}\n'.format(url, e))

else:

self.log.info(u'Python 返回 url:{} 数据成功\n'.format(url))

time.sleep(1) # 1秒返回一个结果 手动设置延迟防止被封

return html

if __name__ == '__main__':

st = GetCaiPiao()新建一个mylog.py日志文件,代码如下:

import logging

import getpass

import sys

# 定义MyLog类

class MyLog(object):

def __init__(self):

self.user = getpass.getuser() # 获取用户

self.logger = logging.getLogger(self.user)

self.logger.setLevel(logging.DEBUG)

# 日志文件名

self.logfile = sys.argv[0][0:-3] + '.log' # 动态获取调用文件的名字

self.formatter = logging.Formatter('%(asctime)-12s %(levelname)-8s %(message)-12s\r\n')

# 日志显示到屏幕上并输出到日志文件内

self.logHand = logging.FileHandler(self.logfile, encoding='utf-8')

self.logHand.setFormatter(self.formatter)

self.logHand.setLevel(logging.DEBUG)

self.logHandSt = logging.StreamHandler()

self.logHandSt.setFormatter(self.formatter)

self.logHandSt.setLevel(logging.DEBUG)

self.logger.addHandler(self.logHand)

self.logger.addHandler(self.logHandSt)

# 日志的5个级别对应以下的5个函数

def debug(self, msg):

self.logger.debug(msg)

def info(self, msg):

self.logger.info(msg)

def warn(self, msg):

self.logger.warn(msg)

def error(self, msg):

self.logger.error(msg)

def critical(self, msg):

self.logger.critical(msg)

if __name__ == '__main__':

mylog = MyLog()

mylog.debug(u"I'm debug 中文测试")

mylog.info(u"I'm info 中文测试")

mylog.warn(u"I'm warn 中文测试")

mylog.error(u"I'm error 中文测试")

mylog.critical(u"I'm critical 中文测试")运行主程序,get_caipiao.py

pycharm截图

get_caipiao.log文件截图

双色球.txt截图

由于写入的是txt文件,不好对齐,后面会写用excel存文件.

代码分析:

mylog.py模块,主要是为程序提供log功能

log功能很重要,在大量爬取的时候,没有log帮助定位,很难找到错误点

主程序:

CaiPiaoItem类定义需要获取的数据

GetCaiPiao类为主程序

geturls方法 获取所有需要爬取的url地址

spider方法 提取每个url地址的详细内容(过滤数据)

pipelines方法 处理数据,数据的存储方式,这里使用的txt

getresponsecontent方法 负责发送请求,拿到响应文件(html)

上一篇: bs4爬虫实战一:获取百度贴吧内容

下一篇: bs4--xlwt存入excel

- openvpn linux客户端使用

52715

- H3C基本命令大全

52634

- openvpn windows客户端使用

42785

- H3C IRF原理及 配置

39652

- Python exit()函数

34027

- openvpn mac客户端使用

30990

- python全系列官方中文文档

29785

- python 获取网卡实时流量

24677

- 1.常用turtle功能函数

24518

- python 获取Linux和Windows硬件信息

22898

- LangGraph Studio可视化

265°

- LangSmith开发-应用入门

267°

- LangGraph开发-多轮对话问答机器人

327°

- LangGraph开发-条件分支/循环图实战

315°

- LangGraph开发-生态介绍,入门demo实战

359°

- LangChain-接入12306-HTTP MCP智能体

513°

- LangChain接入自定义爬虫-MCP工具

488°

- LangChain接入Filesystem-MCP工具

508°

- LangChain搭建MCP服务端和客户端流程

578°

- LangGraph与MCP技术概述

506°

- 姓名:Run

- 职业:谜

- 邮箱:383697894@qq.com

- 定位:上海 · 松江