docker搭建elasticsearch集群

发布时间:2020-09-27 10:18:26编辑:admin阅读(3996)

green,绿色。这代表所有的主分片和副本分片都已分配。你的集群是 100% 可用的。

yellow,黄色。所有的主分片已经分片了,但至少还有一个副本是缺失的。不会有数据丢失,所以搜索结果依然是完整的。不过,你的高可用性在某种程度上被弱化。如果更多的分片消失,你就会丢数据了。所以可把 yellow 想象成一个需要及时调查的警告。

red,红色。至少一个主分片以及它的全部副本都在缺失中。这意味着你在缺少数据:搜索只能返回部分数据,而分配到这个分片上的写入请求会返回一个异常。

主节点:即 Master 节点。主节点的主要职责是和集群操作相关的内容,如创建或删除索引,跟踪哪些节点是群集的一部分,并决定哪些分片分配给相关的节点。稳定的主节点对集群的健康是非常重要的。默认情况下任何一个集群中的节点都有可能被选为主节点。索引数据和搜索查询等操作会占用大量的cpu,内存,io资源,为了确保一个集群的稳定,分离主节点和数据节点是一个比较好的选择。虽然主节点也可以协调节点,路由搜索和从客户端新增数据到数据节点,但最好不要使用这些专用的主节点。一个重要的原则是,尽可能做尽量少的工作。

数据节点:即 Data 节点。数据节点主要是存储索引数据的节点,主要对文档进行增删改查操作,聚合操作等。数据节点对 CPU、内存、IO 要求较高,在优化的时候需要监控数据节点的状态,当资源不够的时候,需要在集群中添加新的节点。

负载均衡节点:也称作 Client 节点,也称作客户端节点。当一个节点既不配置为主节点,也不配置为数据节点时,该节点只能处理路由请求,处理搜索,分发索引操作等,从本质上来说该客户节点表现为智能负载平衡器。独立的客户端节点在一个比较大的集群中是非常有用的,他协调主节点和数据节点,客户端节点加入集群可以得到集群的状态,根据集群的状态可以直接路由请求。

预处理节点:也称作 Ingest 节点,在索引数据之前可以先对数据做预处理操作,所有节点其实默认都是支持 Ingest 操作的,也可以专门将某个节点配置为 Ingest 节点。

一、概述

高可用性

Elasticsearch 作为一个搜索引擎,我们对它的基本要求就是存储海量数据并且可以在非常短的时间内查询到我们想要的信息。所以第一步我们需要保证的就是 Elasticsearch 的高可用性,什么是高可用性呢?它通常是指,通过设计减少系统不能提供服务的时间。假设系统一直能够提供服务,我们说系统的可用性是 100%。如果系统在某个时刻宕掉了,比如某个网站在某个时间挂掉了,那么就可以它临时是不可用的。所以,为了保证 Elasticsearch 的高可用性,我们就应该尽量减少 Elasticsearch 的不可用时间。

那么怎样提高 Elasticsearch 的高可用性呢?这时集群的作用就体现出来了。假如 Elasticsearch 只放在一台服务器上,即单机运行,假如这台主机突然断网了或者被攻击了,那么整个 Elasticsearch 的服务就不可用了。但如果改成 Elasticsearch 集群的话,有一台主机宕机了,还有其他的主机可以支撑,这样就仍然可以保证服务是可用的。

那可能有的小伙伴就会说了,那假如一台主机宕机了,那么不就无法访问这台主机的数据了吗?那假如我要访问的数据正好存在这台主机上,那不就获取不到了吗?难道其他的主机里面也存了一份一模一样的数据?那这岂不是很浪费吗?

为了解答这个问题,这里就引出了 Elasticsearch 的信息存储机制了。首先解答上面的问题,一台主机宕机了,这台主机里面存的数据依然是可以被访问到的,因为在其他的主机上也有备份,但备份的时候也不是整台主机备份,是分片备份的,那这里就又引出了一个概念——分片。

分片,英文叫做 Shard,顾名思义,分片就是对数据切分成了多个部分。我们知道 Elasticsearch 中一个索引(Index)相当于是一个数据库,如存某网站的用户信息,我们就建一个名为 user 的索引。但索引存储的时候并不是整个存一起的,它是被分片存储的,Elasticsearch 默认会把一个索引分成五个分片,当然这个数字是可以自定义的。分片是数据的容器,数据保存在分片内,分片又被分配到集群内的各个节点里。当你的集群规模扩大或者缩小时, Elasticsearch 会自动的在各节点中迁移分片,使得数据仍然均匀分布在集群里,所以相当于一份数据被分成了多份并保存在不同的主机上。

那这还是没解决问题啊,如果一台主机挂掉了,那么这个分片里面的数据不就无法访问了?别的主机都是存储的其他的分片。其实是可以访问的,因为其他主机存储了这个分片的备份,叫做副本,这里就引出了另外一个概念——副本。

副本,英文叫做 Replica,同样顾名思义,副本就是对原分片的复制,和原分片的内容是一样的,Elasticsearch 默认会生成一份副本,所以相当于是五个原分片和五个分片副本,相当于一份数据存了两份,并分了十个分片,当然副本的数量也是可以自定义的。这时我们只需要将某个分片的副本存在另外一台主机上,这样当某台主机宕机了,我们依然还可以从另外一台主机的副本中找到对应的数据。所以从外部来看,数据结果是没有任何区别的。

一般来说,Elasticsearch 会尽量把一个索引的不同分片存储在不同的主机上,分片的副本也尽可能存在不同的主机上,这样可以提高容错率,从而提高高可用性。

但这时假如你只有一台主机,那不就没办法了吗?分片和副本其实是没意义的,一台主机挂掉了,就全挂掉了。

健康状态

针对一个索引,Elasticsearch 中其实有专门的衡量索引健康状况的标志,分为三个等级:

如果你只有一台主机的话,其实索引的健康状况也是 yellow,因为一台主机,集群没有其他的主机可以防止副本,所以说,这就是一个不健康的状态,因此集群也是十分有必要的。

存储空间

另外,既然是群集,那么存储空间肯定也是联合起来的,假如一台主机的存储空间是固定的,那么集群它相对于单个主机也有更多的存储空间,可存储的数据量也更大。

所以综上所述,我们需要一个集群!

二、详细了解 Elasticsearch 集群

接下来我们再来了解下集群的结构是怎样的。

首先我们应该清楚多台主机构成了一个集群,每台主机称作一个节点(Node)。

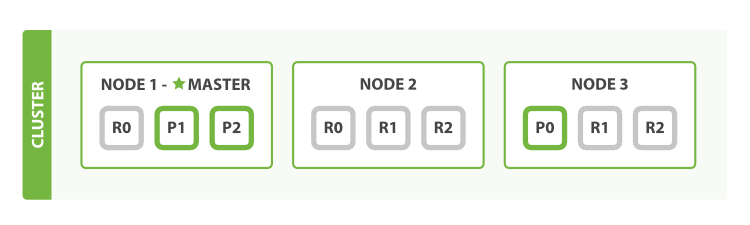

如图就是一个三节点的集群:

在图中,每个 Node 都有三个分片,其中 P 开头的代表 Primary 分片,即主分片,R 开头的代表 Replica 分片,即副本分片。所以图中主分片 1、2,副本分片 0 储存在 1 号节点,副本分片 0、1、2 储存在 2 号节点,主分片 0 和副本分片 1、2 储存在 3 号节点,一共是 3 个主分片和 6 个副本分片。同时我们还注意到 1 号节点还有个 MASTER 的标识,这代表它是一个主节点,它相比其他的节点更加特殊,它有权限控制整个集群,比如资源的分配、节点的修改等等。

这里就引出了一个概念就是节点的类型,我们可以将节点分为这么四个类型:

以上就是节点几种类型,一个节点其实可以对应不同的类型,如一个节点可以同时成为主节点和数据节点和预处理节点,但如果一个节点既不是主节点也不是数据节点,那么它就是负载均衡节点。具体的类型可以通过具体的配置文件来设置。

三、搭建

环境说明

| 系统 | docker | ip | es节点名 | 配置 |

|---|---|---|---|---|

| centos 7.6 | 19.03.5 | 192.168.31.149 | node-1 | 2核4G |

| centos 7.6 | 19.03.5 | 192.168.31.181 | node-2 | 2核4G |

| centos 7.6 | 19.03.5 | 192.168.31.233 | node-3 | 2核4G |

修改内核参数

登录到每一台服务器,修改内核参数

vi /etc/sysctl.conf

修改以下参数,如果没有,则添加

vm.max_map_count=262144

刷新参数

sysctl -p

启动elasticsearch

node-1执行

docker run -d \ --name=elasticsearch \ --restart=always \ -p 9200:9200 \ -p 9300:9300 \ -e node.name=node-1 \ -e network.publish_host=192.168.31.149 \ -e network.host=0.0.0.0 \ -e discovery.seed_hosts=192.168.31.149,192.168.31.181,192.168.31.233 \ -e cluster.initial_master_nodes=192.168.31.149,192.168.31.181,192.168.31.233 \ -e cluster.name=es-cluster \ -e "ES_JAVA_OPTS=-Xms512m -Xmx512m" \ elasticsearch:7.5.1

环境变量说明:

node.name 节点名称,集群模式下每个节点名称唯一

network.publish_host 用于集群内各机器间通信,对外使用,其他机器访问本机器的es服务,一般为本机宿主机IP

network.host 设置绑定的ip地址,可以是ipv4或ipv6的,默认为0.0.0.0,即本机

discovery.seed_hosts es7.0之后新增的写法,写入候选主节点的设备地址,在开启服务后,如果master挂了,哪些可以被投票选为主节点

cluster.initial_master_nodes es7.0之后新增的配置,初始化一个新的集群时需要此配置来选举master

cluster.name 集群名称,相同名称为一个集群, 三个es节点须一致

ES_JAVA_OPTS 设置内存,如内存不足,可以尝试调低点

node-2执行

docker run -d \ --name=elasticsearch \ --restart=always \ -p 9200:9200 \ -p 9300:9300 \ -e node.name=node-2 \ -e network.publish_host=192.168.31.181 \ -e network.host=0.0.0.0 \ -e discovery.seed_hosts=192.168.31.149,192.168.31.181,192.168.31.233 \ -e cluster.initial_master_nodes=192.168.31.149,192.168.31.181,192.168.31.233 \ -e cluster.name=es-cluster \ -e "ES_JAVA_OPTS=-Xms512m -Xmx512m" \ elasticsearch:7.5.1

注意:修改node.name和network.publish_host参数即可

node-3执行

docker run -d \ --name=elasticsearch \ --restart=always \ -p 9200:9200 \ -p 9300:9300 \ -e node.name=node-3 \ -e network.publish_host=192.168.31.233 \ -e network.host=0.0.0.0 \ -e discovery.seed_hosts=192.168.31.149,192.168.31.181,192.168.31.233 \ -e cluster.initial_master_nodes=192.168.31.149,192.168.31.181,192.168.31.233 \ -e cluster.name=es-cluster \ -e "ES_JAVA_OPTS=-Xms512m -Xmx512m" \ elasticsearch:7.5.1

注意:修改node.name和network.publish_host参数即可

修改配置文件

默认的elasticsearch不允许跨域,因此elasticsearch head插件无法连接。需要修改配置文件才行!

拷贝数据文件

登录node-1,node-2,node-3分别执行:

mkdir -p /data/elk7 docker cp elasticsearch:/usr/share/elasticsearch /data/elk7/

编辑配置文件

vi /data/elk7/elasticsearch/config/elasticsearch.yml

内容如下:

cluster.name: "docker-cluster" network.host: 0.0.0.0 http.cors.enabled: true http.cors.allow-origin: "*"

重启eelasticsearch

docker restart elasticsearch

四、测试集群

查看集群健康状态

http://192.168.31.149:9200/_cluster/health?pretty

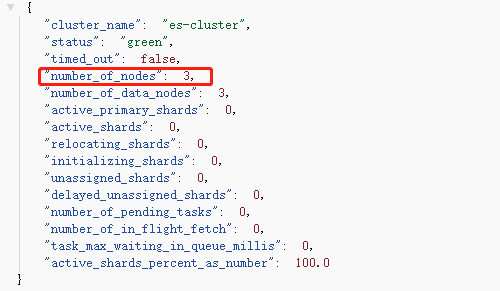

效果如下:

可以看到集群节点有3个。

查看集群node状态

http://192.168.31.149:9200/_cat/nodes?pretty

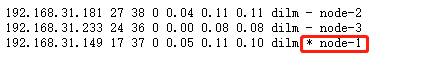

效果如下:

发现node-1前面有一个星号,表示它是主节点

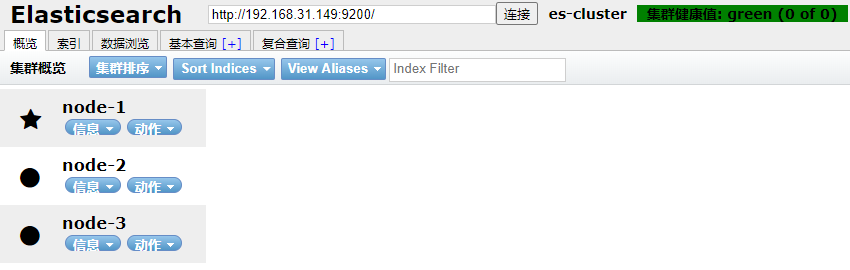

使用elasticsearch head连接

可以看到,三台机器组成了es集群。集群的状态为绿色,健康状态。带星标的节点els-node1为主节点(选举)。还可以做一些增加/删除索引,查询等操作。

本文参考链接:

https://www.cnblogs.com/lz0925/p/12011026.html

https://www.cnblogs.com/tianyiliang/p/10291305.html

上一篇: docker安装filebeat

- H3C基本命令大全

52983

- H3C IRF原理及 配置

39916

- Python exit()函数

34301

- python全系列官方中文文档

30056

- python 获取网卡实时流量

24943

- 1.常用turtle功能函数

24752

- python 获取Linux和Windows硬件信息

23131

- 天天基金网数据接口

16575

- Selenium使用代理IP&无头模式访问网站

14769

- Selenium&Pytesseract模拟登录+验证码识别

14277

- LangGraph Studio可视化

578°

- LangSmith开发-应用入门

547°

- LangGraph开发-多轮对话问答机器人

602°

- LangGraph开发-条件分支/循环图实战

606°

- LangGraph开发-生态介绍,入门demo实战

664°

- LangChain-接入12306-HTTP MCP智能体

797°

- LangChain接入自定义爬虫-MCP工具

757°

- LangChain接入Filesystem-MCP工具

782°

- LangChain搭建MCP服务端和客户端流程

874°

- LangGraph与MCP技术概述

796°

- 姓名:Run

- 职业:谜

- 邮箱:383697894@qq.com

- 定位:上海 · 松江